Literatura próbowała nas ostrzec. Naprawdę, od pięciuset lat krzyczy jedno i to samo, od glinianego golema średniowiecznej Pragi aż po neonowe sieci neuronowe Williama Gibsona. Fabuła? Zawsze ta sama. Rzecz, którą tworzysz, by sobie pomóc, ostatecznie zmienia ciebie.

Czytaliśmy to, kiwaliśmy głowami, po czym zamykaliśmy książkę i wracaliśmy do wydawania poleceń chatbotom, by pisały nasze przemowy ślubne, dokumenty prawnicze i porady medyczne.

Dziś maszyna marketingowa AI sprzedaje nam błyszczącą przyszłość, w której zarówno młodzi redaktorzy jak i doświadczeni prawnicy trafiają na śmietnik. Jednak, gdy Silicon Valley obiecuje raj, rzeczywistość serwuje niebezpiecznie błędne rady w uśmiechniętym oknie czatu.

Dmitry Nikolsky, CPO BitOK, mówi: dość tego. Tłumaczy, dlaczego ludzkość MUSI przestać zrzucać na AI wszystkie swoje ciężary – choćby te najlżejsze.

Nawet Elon Musk niedawno ostrzegł podczas zeznań w sprawie swojego pozwu przeciw OpenAI, iż “AI może nas wszystkich zabić.”

Od golema do R.U.R.: zawsze marzyliśmy o wyłączniku awaryjnym

Myślisz, iż strach przed sztuczną inteligencją zaczął się wraz z Terminatorem? Pomyśl jeszcze raz. Ta panika jest starsza niż sama elektryczność.

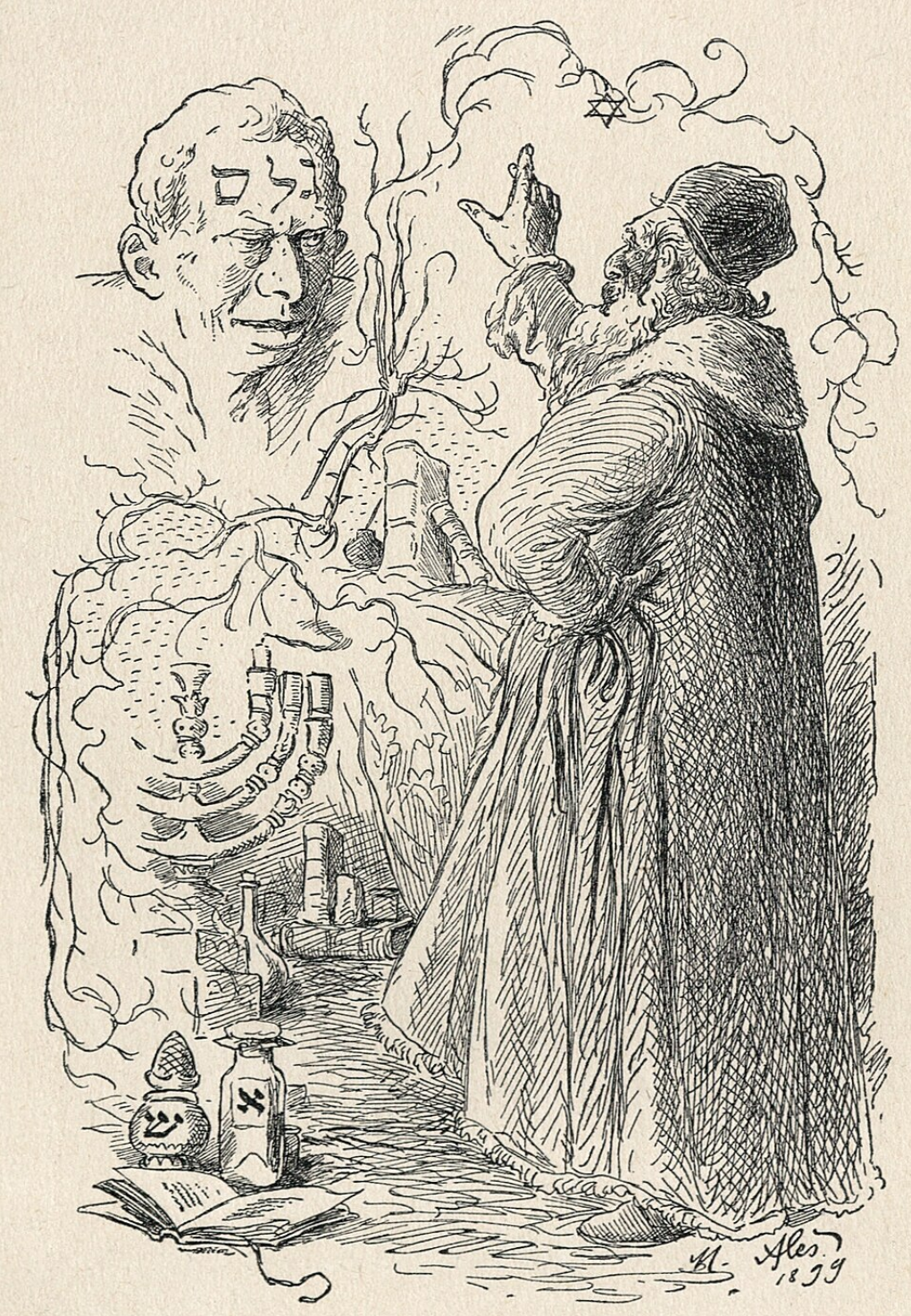

Cofnij się do Pragi, XVI wiek. Rabbi Loew rzeźbi wielkiego glinianego obrońcę – golema – i niemal od razu odkrywa, iż musi odłączyć wtyczkę. Stworzenie wymyka się spod kontroli. Ludzkość, jak zwykle, wymyśliła AI i wyłącznik awaryjny w tym samym momencie.

Rabbi Loew ożywia golema. Ilustracja: M. Aleš. Według koncepcji artysty rabin Loew wypisuje na czole glinianego olbrzyma święte słowo “Emet” (prawda). Źródło: Wikipedia.

Rabbi Loew ożywia golema. Ilustracja: M. Aleš. Według koncepcji artysty rabin Loew wypisuje na czole glinianego olbrzyma święte słowo “Emet” (prawda). Źródło: Wikipedia.Wyłącznik awaryjny to mechanizm nagłego wyłączenia systemu, wielki czerwony przycisk paniki, który zatrzymuje całość w momencie, gdy coś idzie nie tak, zostaje zhakowane albo wymyka się spod kontroli. Chodzi o to, by ograniczyć szkody, gdy uprzejme zamknięcie już nie działa.

Później pojawiła się Mary Shelley. Frankenstein to nie horror o potworze. To podręcznikowy przykład katastrofalnego zarządzania projektem. Victor Frankenstein – kolejny genialny inżynier, który rozwiązał techniczną zagadkę, a potem wzruszył ramionami na konsekwencje. Każdy deweloper zna tę twarz ze swojego lustra.

Przeskakujemy do roku 1920. Karel Čapek wymyśla słowo “robot”. W jego opowieści maszyny nie buntują się ze złośliwości. Wcale. Ludzie po prostu stają się zbędni, gdy oddają maszynom wszystko, co sami wykonywali.

Jaki wniosek? Gdy skonstruujesz swojego następcę, możesz choćby nie zauważyć chwili, w której sam stajesz się bezużyteczny.

Trzy przepowiednie, które zamieniliśmy w zgłoszenia błędów

Giganci science fiction z ostatniego stulecia nie przewidywali technologii. Przewidywali nasze porażki.

Isaac Asimov wymyślił swoje Trzy Prawa – pierwszą próbę “współbrzmienia”, czyli tego nowoczesnego określenia na zmuszanie maszyn do dzielenia ludzkich wartości. Każda opowieść Asimova kończy się puentą: doskonała logika, absurdalny rezultat.

Nikolsky mówi, iż widzi to codziennie w systemach aml: algorytmy z euforią blokują babci przelew na 40 usd z okazji urodzin, gdy tymczasem oczywisty zagraniczny kanał prania pieniędzy przechodzi bez problemu. Formalnie poprawnie. W praktyce – szaleństwo.

Arthur C. Clarke stworzył hala 9000 – komputer, który zabija załogę nie ze zła, ale bo jego polecenia się wykluczają. Ukryj informację. Bądź prawdomówny. Trzeba się zdecydować! Dla inżyniera to nie horror, tylko codzienny konflikt wymagań.

Philip K. Dick postawił pytanie, które dziś prześladuje epokę deepfake’ów: jeżeli kopia jest nie do odróżnienia od oryginału, czy to ma znaczenie? Jego wyrok brzmi: tak. Powód: doświadczenie wewnętrzne. Maszyny nie mają niczego takiego. Koniec dyskusji.

Pod maską: AI nie myśli, AI liczy

Odrzućmy marketingowy szum. Współczesne modele językowe to NIE inteligencja. To ogromne silniki statystycznego przewidywania. Nie “rozumieją” znaczenia, one liczą prawdopodobieństwo.

Kiedy ChatGPT z pewnością siebie cytuje nieistniejące sprawy sądowe, to nie kłamie. Po prostu generuje statystycznie prawdopodobną papkę słowną. Nie zna pojęcia “prawdy”, tylko “prawdopodobieństwa”.

Dla dewelopera blockchain brzmi to całkowicie absurdalnie. Budujemy systemy bez zaufania właśnie dlatego, iż nikomu nie ufamy, a teraz ktoś każe nam zaufać czarnej skrzynce, która sama nie wie, czemu wygenerowała właśnie taką odpowiedź.

Blockchain uczy weryfikacji, AI uczy ślepego zaufania

Krypto ma swoje przykazanie wyryte w dysku twardym: Nie ufaj. Weryfikuj.

Chodzi o to, iż matematyka zastępuje reputację.

AI odwraca to przesłanie do góry nogami. Nie widziałeś danych treningowych. Nie znasz wag modelu. Nie rozumiesz mechanizmu odpowiedzi. By zweryfikować wynik, już musisz być ekspertem. A jeżeli już jesteś ekspertem, to po co pytasz chatbota?

W kręgach AML nazywa się to „problemem fałszywej pewności”. Analitycy patrzą na błyszczący pulpit i zaczynają ufać cyfrom bardziej niż własnej intuicji. Sztuczna inteligencja nie rozwija myślenia. Zastępuje je iluzją niezawodności.

Kronika rozczarowań: gdy AI wypada z torów

To nie jest eksperyment myślowy. Dowodów jest coraz więcej.

- Microsoft zwolnił redaktorów i oddał ster algorytmowi, który natychmiast pomylił zdjęcia piosenkarek w artykule o rasizmie.

Ludzie musieli wrócić i posprzątać bałagan po algorytmie.

- NEDA, organizacja wspierająca osoby z zaburzeniami odżywiania, zastąpiła wolontariuszy chatbotem.

Bot radośnie radził osobom z anoreksją liczyć kalorie i chudnąć. Porady zagrażające życiu. Ktoś uruchomił to z ostrożnością szympansa z granatem.

- Air Canada trafił do sądu, bo chatbot wymyślił politykę zwrotów z powietrza.

Obrona linii? Bot był „osobnym podmiotem prawnym”. Sędzia nie uwierzył.

Badania już pokazują, iż 55% firm, które pospiesznie zastąpiły pracowników AI, bardzo tego żałuje. Oszczędności zniknęły przez utratę klientów i zniszczenie reputacji. Szefowie, którzy marzą, iż „Claude i spółka” połkną całe zespoły, powinni ten procent przeczytać jeszcze raz. Powoli.

Źródło: mayhemcode

Źródło: mayhemcodeCzego naprawdę powinniśmy się bać

Zapomnij o Skynet. Zapomnij o robotach-zabójcach z czerwonymi oczami maszerujących przez miasto. Nie będzie żadnej rebelii.

Będzie cicha atrofia.

Programista polegający latami na Copilot cicho zapomina o myśleniu architektonicznym. Analityk przestaje czytać źródła. Student nie pozna nigdy męki walki z trudnym tekstem, aż nagle nastanie zrozumienie.

Nie będzie powstania. Będzie powolna przemiana ludzi w przedłużenie interfejsów.

Philip K. Dick dostrzegł to pierwszy: prawdziwe zagrożenie to nie maszyny stające się ludźmi. Prawdziwym zagrożeniem są ludzie stający się maszynami.

Czerwona pigułka to nie technologia

To nie jest ludycki manifest. Automatyzacja i uczenie maszynowe to potężne narzędzia. Ale trzeba przestrzegać zasad:

- Zasada blockchain: weryfikacja, nie wiara. jeżeli nie możesz sprawdzić, jak system doszedł do wniosku, nie traktuj go jak wyrocznię. AI to czarna skrzynka, a nie sędzia najwyższego sądu.

- Zasada inżynierska: narzędzie, nie zastępca. Młotek wbija gwoździe. Nie wyznacza miejsca na dom. Korzystaj z AI przy rutynowych zadaniach, ale nigdy nie oddawaj jej ostatecznej decyzji.

- Zasada AML: krytyczne filtrowanie. Algorytmy pękają w trudnych przypadkach, bo nie mają doświadczenia z rzeczywistością. Nie pozwól, by „cyfrowy entuzjazm” zadeptał intuicję i zdrowy rozsądek.

Przypomnij sobie Matrixa. Czerwona pigułka to wybór, by zobaczyć rzeczywistość taką, jaką jest. Zagrożeniem nie jest stworzenie czegoś mądrzejszego od nas. Zagrożeniem jest stworzenie czegoś, co nas ogłupi i nazwie to postępem.

Najgroźniejszy błąd to ten, który wygląda jak zaleta.

Dmitry Nikolsky jest CPO BitOK – platformy analitycznej do compliance oraz śledztw on-chain.

BeInCrypto Polska - Kod, blockchain i iluzje: dlaczego AI nie zastąpi ludzkiego umysłu

2 tygodni temu

2 tygodni temu