Rywalizacja o dominację w sektorze security AI nabiera tempa, gdy OpenAI wprowadza model GPT-5.4-Cyber w bezpośredniej odpowiedzi na sukcesy konkurencyjnego projektu Anthropic. Nowy wariant flagowego modelu stawia na większą swobodę operacyjną badaczy, co ma najważniejsze znaczenie w wyścigu o łatanie luk w infrastrukturze krytycznej.

Wtorkowa premiera GPT-5.4-Cyber to coś więcej niż tylko kolejna iteracja flagowego modelu. To strategiczne przesunięcie granicy tego, na co twórcy AI pozwalają swoim użytkownikom. Podczas gdy Anthropic stawia na rygorystycznie kontrolowaną inicjatywę dla wybranych, OpenAI decyduje się na model „bardziej permisywny”. W praktyce oznacza to poluzowanie gorsetu zabezpieczeń, który dotychczas często uniemożliwiał badaczom pełną analizę złośliwego kodu czy symulację ataków z obawy przed naruszeniem polityk bezpieczeństwa samej platformy.

Kluczem do strategii OpenAI nie jest jednak wyłącznie technologia, ale ekosystem. Firma drastycznie skaluje program Trusted Access for Cyber (TAC), otwierając go na tysiące indywidualnych ekspertów i setki zespołów dbających o infrastrukturę krytyczną. Wprowadzenie wielopoziomowej weryfikacji to pragmatyczne rozwiązanie problemu „podwójnego zastosowania” sztucznej inteligencji. Wyższe poziomy zaufania odblokowują potężniejsze funkcje GPT-5.4-Cyber, dając obrońcom narzędzie o skuteczności zbliżonej do tej, jaką dysponują napastnicy, ale w ramach prawnych i etycznych ram.

W tym starciu OpenAI stawia na masowość i mniejszą liczbę restrykcji dla sprawdzonych partnerów, licząc, iż to właśnie szeroka społeczność „białych kapeluszy” stanie się ich najsilniejszym atutem. Decyzja ta niesie ze sobą ryzyko, ale w obliczu coraz bardziej wyrafinowanych zagrożeń, strategia „kontrolowanej otwartości” może okazać się jedyną skuteczną drogą do zabezpieczenia cyfrowej przyszłości.

3 tygodni temu

3 tygodni temu

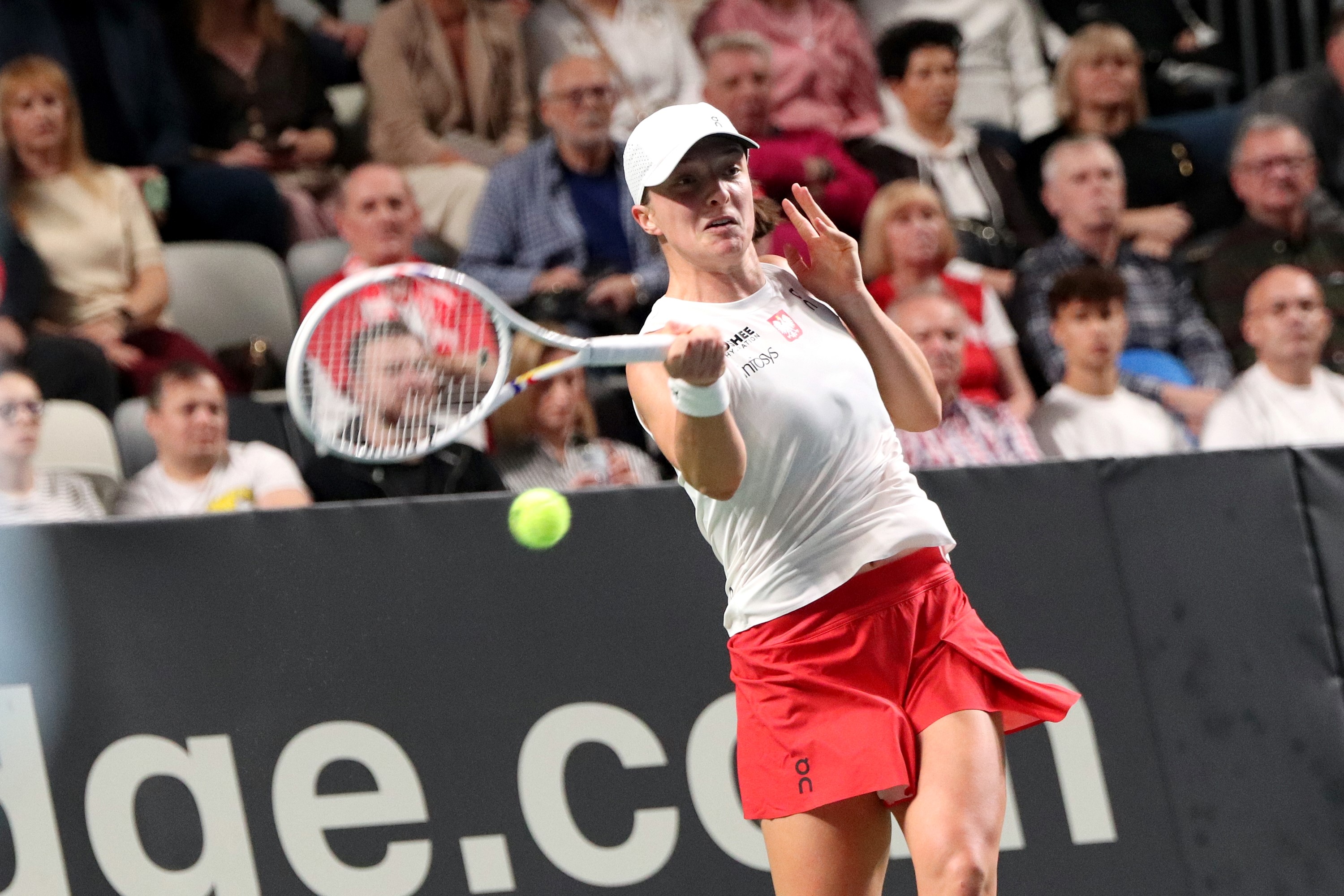

![WTA Rzym: Iga Świątek — Jessica Pegula [RELACJA NA ŻYWO]](https://cdn.przegladsportowy.onet.pl/1/LLIk9lBaHR0cHM6Ly9vY2RuLmV1L3B1bHNjbXMvTURBXy9iMDU0MzdkYTcxZDlkNmZkOGM4OThjMjc0Y2Y2ZGQ2Ni5wbmeSlQMAAM0HgM0EOJMFzQlgzQZA3gACoTAHoTEE)

![WTA Rzym: Kiedy i o której Iga Świątek gra z Jessicą Pegulą? [TRANSMISJA]](https://i.iplsc.com/-/000MRQ7Q0KXY3G45-C461.jpg)